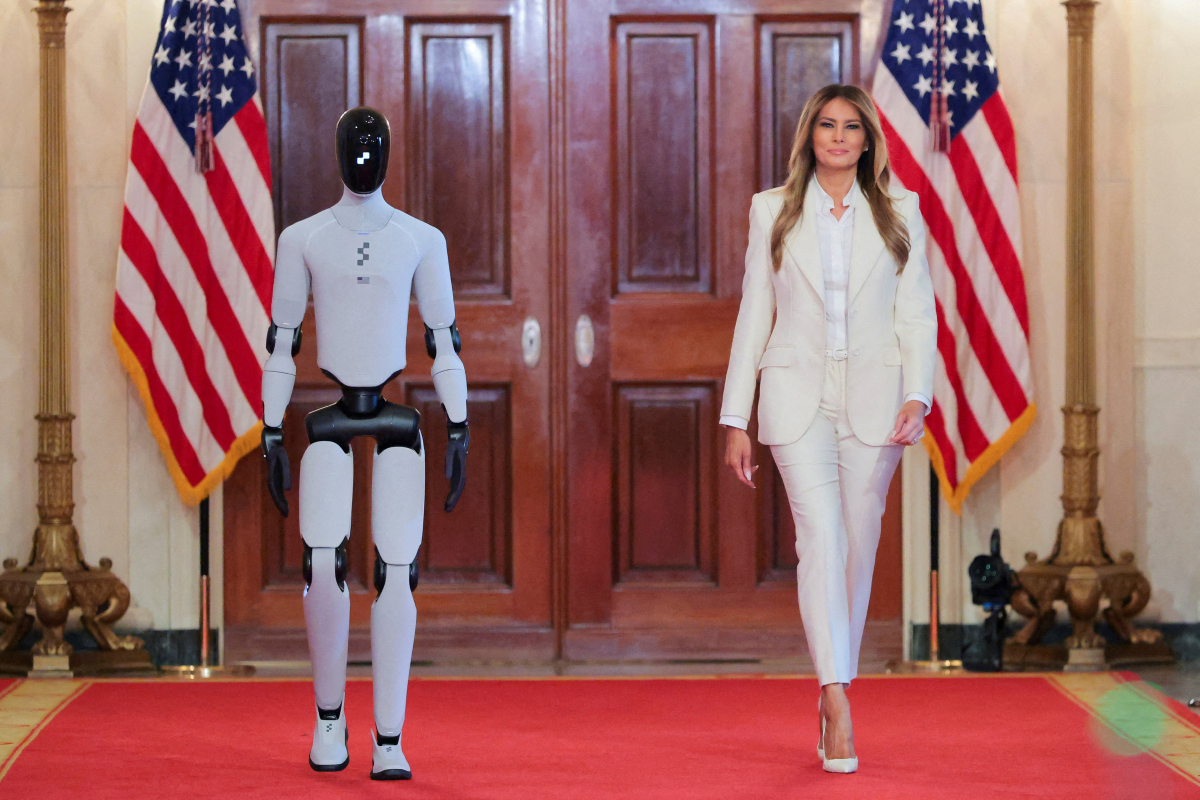

Các vấn đề về trách nhiệm pháp lý và quyền kiểm soát được giới chuyên gia quan tâm khi robot ngày càng tương tác nhiều hơn với thế giới thực - Ảnh: Tân Hoa Xã

Kế hoạch 5 năm mới nhất của Bắc Kinh đã vạch ra tham vọng ứng dụng trí tuệ nhân tạo (AI) sâu rộng vào nền kinh tế, coi đây là chìa khóa giải quyết tình trạng thiếu hụt lao động và nâng cao năng suất.

Nhưng khi máy móc ngày càng thông minh hơn, các rủi ro về dữ liệu và trách nhiệm pháp lý cũng tăng vọt, buộc giới quản lý và chuyên gia phải nhanh chóng tìm ra giải pháp kiểm soát.

"Khoảnh khắc ChatGPT"

Báo cáo công tác chính phủ năm 2026 và dự thảo Kế hoạch 5 năm lần thứ 15 của Trung Quốc đều xếp AI hiện thân (embodied AI) vào nhóm ngành tương lai cần được ưu tiên phát triển, ngang với các lĩnh vực chiến lược như 6G, giao diện não - máy tính và công nghệ lượng tử.

Trong bản kế hoạch này, AI được nhắc đến hơn 50 lần, kèm theo chương trình "AI+" với phạm vi triển khai rộng khắp các ngành - từ sản xuất, logistics đến giáo dục và y tế.

Về tiềm năng kinh tế, một báo cáo của Trung tâm Nghiên cứu phát triển Quốc vụ viện Trung Quốc cuối năm 2025 ước tính quy mô thị trường AI hiện thân sẽ đạt 400 tỉ nhân dân tệ vào năm 2030 và vượt mốc 1.000 tỉ nhân dân tệ vào năm 2035.

Tại phiên thảo luận thuộc Diễn đàn châu Á Bác Ngao (BFA) ngày 25-3, ông Vương Hiểu Cương - nhà đồng sáng lập công ty công nghệ SenseTime - nhận định rằng nhờ các AI agent như OpenClaw, "khoảnh khắc ChatGPT" của robot hình người có thể đến chỉ trong hai năm nữa. Theo ông, các tác nhân AI này có khả năng tự gọi công cụ, tự phản tư, tự ghi nhớ, giúp robot chuyển từ hoạt động riêng lẻ sang phối hợp theo nhóm, vừa làm vừa học trong khi khám phá môi trường và thực hiện thao tác.

Thách thức quản trị

Một trong những vấn đề gây tranh cãi nhất hiện nay là cách thu thập và sử dụng dữ liệu. Phát biểu tại BFA, cựu Thủ tướng New Zealand Jenny Shipley cảnh báo cuộc sống bình thường của con người đang bị biến thành dữ liệu đầu vào để huấn luyện robot. Nếu không có cơ chế cấp phép hoặc sự đồng ý có ý thức từ người dân, quá trình này sẽ vi phạm các nguyên tắc đạo đức cơ bản.

Bà Jenny Shipley nhấn mạnh công nghệ không nên đổi mới chỉ vì mục đích đổi mới, mà phải xác định rõ rốt cuộc phục vụ ai.

Song song đó, vấn đề trách nhiệm pháp lý và quyền kiểm soát khi máy móc tương tác với thế giới vật lý cũng đặt ra nhiều thách thức. Theo tờ Chứng Khoán Thời Báo ngày 26-3, ông Trần Kiến Vũ - nhà sáng lập Công ty Robot Era - khẳng định robot không được phép tự đặt mục tiêu hay tự ra quyết định: chúng chỉ đưa ra gợi ý, còn con người thiết lập ranh giới hành vi và quyết định cuối cùng.

Ông Hùng Hữu Quân, Giám đốc Trung tâm Đổi mới robot hình người Trung Quốc, bổ sung rằng robot nên tiếp nhận các công việc nguy hiểm và lặp lại, để con người tập trung vào sáng tạo và những công việc đòi hỏi cảm xúc.

Để hiện thực hóa triết lý đó, cuối tháng 2-2026, Bộ Công nghiệp và Công nghệ thông tin Trung Quốc ban hành Hướng dẫn xây dựng hệ thống tiêu chuẩn robot hình người 2026.

Theo Tân Hoa xã ngày 3-3, đây là hệ thống tiêu chuẩn quốc gia đầu tiên bao phủ toàn bộ vòng đời sản phẩm - từ thiết kế, huấn luyện dữ liệu đến triển khai và vận hành - với sự tham gia của hơn 120 viện nghiên cứu, doanh nghiệp và đơn vị ứng dụng.

Hệ thống gồm sáu trụ cột: tiêu chuẩn nền tảng chung, tính toán và trí tuệ mô phỏng thần kinh, tay chân và linh kiện, tích hợp toàn hệ thống, ứng dụng, và đặc biệt là an toàn cùng đạo đức.

Ngoài vai trò "phanh hãm", hệ thống này còn đóng vai trò như đường ray dẫn đường thống nhất các quy định kỹ thuật, phá bỏ rào cản tương thích giữa các nhà sản xuất, giảm chi phí chuỗi cung ứng, đồng thời yêu cầu mọi sản phẩm phải tuân thủ ngưỡng an toàn tối thiểu - bao gồm tích hợp cơ chế dừng khẩn cấp ngay từ khâu thiết kế phần cứng.

Hướng tiếp cận chung hiện nay là "bước những bước nhỏ, phát triển đến đâu quản trị đến đó". Phó chủ tịch điều hành Tập đoàn Baidu, ông Thẩm Đẩu, lập luận rằng thay vì chờ công nghệ hoàn thiện mới lo ngại rủi ro, xây dựng cơ chế phòng ngừa ngay trong quá trình phát triển sẽ hiệu quả hơn nhiều - một xu hướng tương tự với cách Singapore và Liên minh châu Âu đã ban hành các đạo luật quản trị AI dựa trên đạo đức.

Theo Tân Hoa xã, Ủy ban Quản lý tiêu chuẩn hóa Trung Quốc sẽ tiếp tục phối hợp với các cơ quan, doanh nghiệp và trường đại học để xây dựng tiêu chuẩn cụ thể cho từng khâu trong chuỗi phát triển robot hình người, bổ sung các cơ chế quản trị và an toàn khi robot ngày càng tham gia sâu hơn vào đời sống và sản xuất.

Chuyên gia Oxford nhắc nhở về quản trị AI toàn cầu

Bên lề Diễn đàn châu Á Bác Ngao (BFA) tháng 3-2026, chuyên gia cố vấn Sam Daws thuộc Sáng kiến Oxford Martin về quản trị AI của Đại học Oxford nhấn mạnh rằng các bộ khung quản trị AI phải tiếp tục tiến hóa theo chính đà tiến của công nghệ.